作者: 新能源日志锂电池

一种采用多种神经网络预测锂离子电池剩余使用寿命的机器学习框架

--本文共计约3603字,阅读时间约12分钟--

Comments

这篇论文系统地测试了七种不同的人工智能神经网络模型,来看谁能更准、更快地预测电池还能用多久。结果发现,一个叫ResNet的模型最准,而另一个叫1D-CNN的模型不仅准,速度还飞快,非常适合用在电动车上。在电池管理领域,精准预测“剩余使用寿命”(Remaining Useful Life, RUL)直接关系到电动车的安全、续航和成本。过去的研究五花八门,大家各自用不同的模型和数据,就像在不同的赛道上比赛,很难说清到底哪种方法最好。这篇论文的价值在于,它建立了一个标准化的机器学习框架,相当于统一了“赛道规则”,把当前主流的七种神经网络模型拉到一起进行了一场“摸底大比武”。通过长达145天的精细调校,确保每个“选手”都发挥出最佳水平。研究发现,性能最优的模型(ResNet)仅用40个早期循环的数据,就能达到10.7%的预测误差,这证明了早期精准预测的可行性。更重要的是,它指出了1D-CNN这类计算效率极高的模型是嵌入式系统(如车载BMS)的理想选择,为AI技术在车辆端的实际应用铺平了道路。

摘要

本研究旨在为锂离子电池的剩余使用寿命(RUL)预测提供一个系统性的评估框架。研究者们在一个包含124个锂离子电池的数据集上,仅使用30%的数据作为训练集,对七种不同的人工智能神经网络(ANN)架构进行了全面评估。为了保证比较的公平性,每种架构都通过了长达145天的精细化“超参数优化”(Hyperparameter Optimization,即调整模型内部设置以达到最佳性能的过程),确保所有模型都在其最佳配置下进行RUL预测。研究还探讨了使用不同“循环窗口”(Cycle Windows,即用于分析的充放电数据片段)对预测精度的影响。最终,表现最佳的模型仅利用40个循环周期的数据特征,就实现了10.7%的平均绝对百分比误差(Mean Absolute Percentage Error, MAPE),展示了该框架的有效性。

引言

研究背景: 锂离子电池的RUL预测对于提升其运行效率和安全性至关重要。虽然人工神经网络(ANNs)在此领域展现出巨大潜力,但现有研究普遍缺乏标准化的评估体系。不同的研究采用了不同的数据集、训练方法和评价指标,导致模型性能难以横向比较。此外,大多数研究侧重于电池生命末期的预测,而对于早期预测的关注不足,并且很少有文献详细阐述其模型优化过程,这给后续研究带来了挑战。

本文贡献: 本文的主要贡献在于弥补了当前研究的空白,提供了一个全面且系统的评估框架。

•贡献一:开发了一个统一的机器学习框架,能够系统性地评估和比较七种主流的ANN架构,包括CNN、LSTM、CNN-LSTM、Bi-LSTM-Attn、Transformer、ResNet和TCN。

•贡献二:对每种模型都进行了严谨的超参数优化,确保所有模型都在其接近最佳性能的水平上进行公平比较,为RUL预测提供了一个标准化的基准。

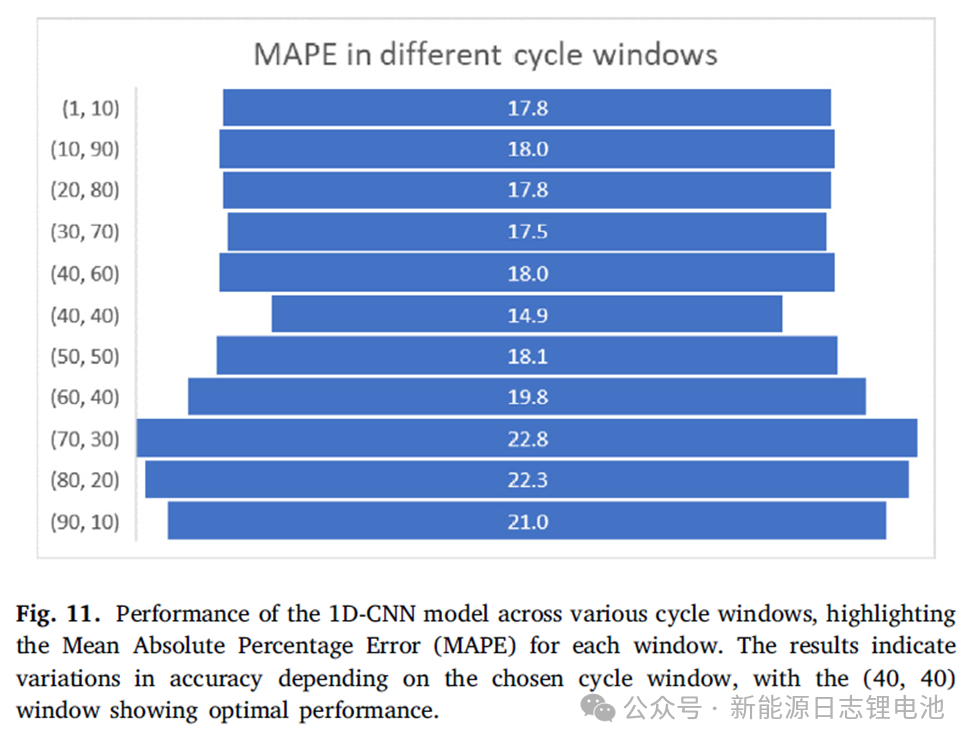

•贡献三:深入研究了不同循环窗口对模型性能的影响,并发现了一个最优的预测窗口((40, 40)窗口),这一发现对未来的研究具有指导意义。

•贡献四:证明了仅使用少量早期循环数据(124个电池中的30%数据)和逐周期特征,即可实现高精度的RUL预测,其中最优模型的MAPE达到了10.7%。

实验设计

实验对象: 本研究使用了由Severson等人发布的公开数据集,该数据集包含了124个商用方形锂离子电池(磷酸铁锂/石墨体系)在不同快速充电策略下的循环数据。计算和模型训练则在一台配备了英特尔i9-13900KF CPU和NVIDIA GeForce RTX 4090 GPU的高性能计算机上完成。 测试条件: 所有电池都经历了不同的快速充电方案,模型训练仅使用了整个数据集中30%的样本。整个超参数优化过程持续了145天,以确保找到每个模型的最优或近优配置。

研究方法

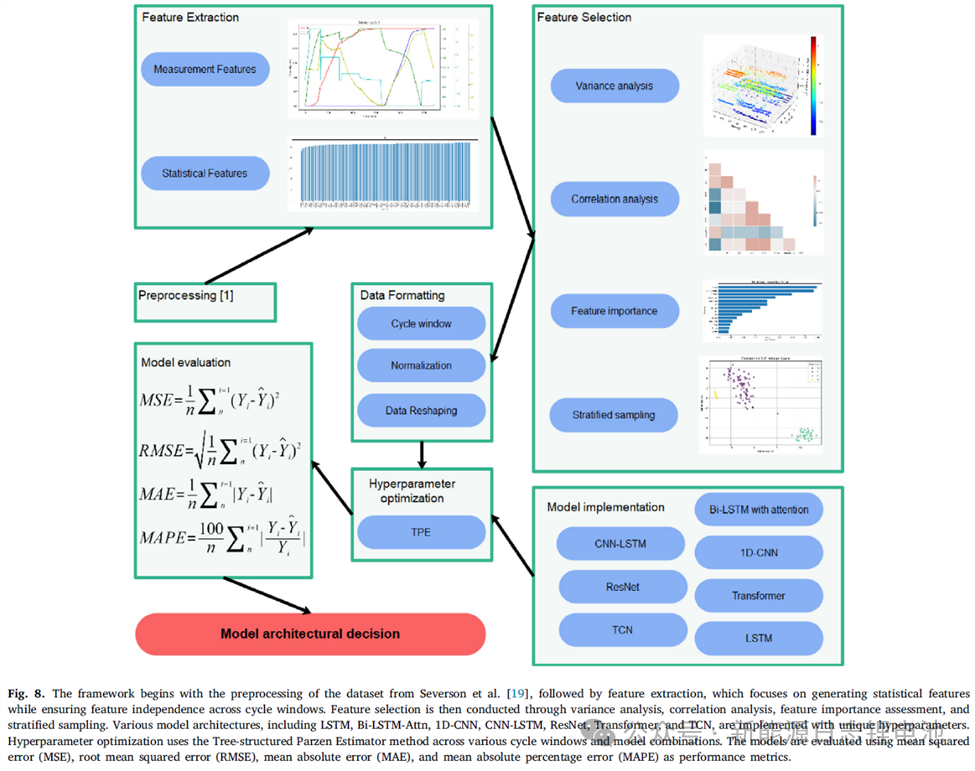

核心思路/总体框架: 本文的技术路线是一个完整的机器学习流程:首先对原始数据进行预处理,然后进行特征提取与筛选,接着将数据格式化并定义不同的循环窗口,随后实现七种不同的ANN模型,并利用“树状结构Parzen估计器”(Tree-structured Parzen Estimator, TPE,一种高效的贝叶斯优化算法)对每个模型进行大规模的超参数优化,最后通过多项性能指标对优化后的模型进行评估和比较,从而做出最终的模型架构决策。 关键模型/理论基础: 本研究评估了七种先进的神经网络架构,它们各自的原理如下:

•1D-CNN (一维卷积神经网络): 类似于图像处理中的CNN,但它专门处理一维序列数据(如时间序列信号),通过“卷积核”(Filters)来自动提取数据中的局部模式和特征。

•LSTM (长短期记忆网络): 一种特殊的“循环神经网络”(Recurrent Neural Network, RNN),通过其内部精巧的“门控机制”(Gating Mechanisms),能够有效学习和记忆时间序列数据中的长期依赖关系,解决了传统RNN的“梯度消失”问题。

•Bi-LSTM-Attn (带注意力机制的双向长短期记忆网络): LSTM的增强版。“双向”(Bi-directional)意味着它能同时从过去和未来两个方向分析数据;“注意力机制”(Attention)则让模型能自动聚焦于输入序列中对预测结果最重要的部分。

•Transformer: 最初为自然语言处理设计,其核心是“多头自注意力机制”(Multi-head Self-attention),它不依赖于顺序处理,而是直接计算序列中所有数据点之间的相互重要性,能捕捉更复杂的全局依赖关系,且易于并行计算。

•ResNet (残差神经网络): 通过引入“跳跃连接”(Skip Connections),允许信息和梯度直接“跨层”传播,从而解决了深度神经网络中常见的“网络退化”(即网络越深,性能反而下降)问题,使得训练非常深的网络成为可能。

•TCN (时间卷积网络): 结合了卷积网络和RNN的优点。它使用“因果卷积”(Causal Convolutions)确保预测只依赖于过去的数据,并通过“空洞卷积”(Dilated Convolutions)极大地扩展了感受野,能够高效地处理非常长的时间序列。

•CNN-LSTM: 一种混合模型,它首先用CNN层从输入数据中提取空间或局部特征,然后将这些特征序列输入到LSTM层中,以捕捉它们之间的时间动态关系。

结果与讨论

Figure 11: 该图展示了1D-CNN模型在不同循环窗口下的预测误差(MAPE)。核心信息是,使用第40到80个循环的数据(即(40, 40)窗口)时,模型的预测效果最好,这说明并非数据越多越好。

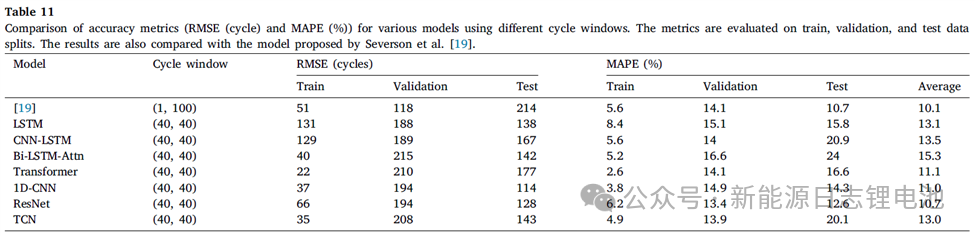

Table 10: 这张表格汇总了七种模型在大量测试后MAPE的统计数据(如平均值、最小值、最大值等)。它清晰地显示,ResNet模型获得了最低的预测误差(10.76%),但其性能波动较大;而1D-CNN和Transformer的表现则更加稳定。

Table 11: 该表直接对比了所有优化后模型在训练集、验证集和测试集上的最终性能。结果表明,ResNet的平均MAPE最低(10.7%),是表现最佳的模型,紧随其后的是1D-CNN(11.0%)和Transformer(11.1%)。

Figure 14: 这张图比较了不同模型的训练时间和单次预测所需时间。它突显出1D-CNN的预测速度最快(仅62毫秒),而Bi-LSTM-Attn最慢(1513毫秒),这对模型的实际应用至关重要。

主要发现:

1.最佳的预测数据窗口并非最长的数据段。研究发现(40, 40)这个中间阶段的循环窗口预测效果最好,这挑战了“数据越多,预测越准”的传统观念。

2.在七种模型中,ResNet架构的预测精度最高,其平均MAPE为10.7%。1D-CNN和Transformer架构的性能也极具竞争力。

3.模型的复杂性、精度和计算速度之间存在明显的权衡关系。1D-CNN模型在精度和速度之间取得了极佳的平衡,其极快的预测速度使其非常适合部署在计算资源有限的车载BMS等嵌入式系统中。

4.合理的数据集划分策略至关重要。通过采用“分层采样”(Stratified Sampling),1D-CNN模型的MAPE从14.9%显著降低到了10.9%,提升了模型的泛化能力。

- 作者的解读: 作者认为,(40, 40)窗口表现优异可能意味着在该数据集中,电池退化的长期依赖性并不如预想中那么强,而这个特定阶段的数据包含了最关键的退化信息。仅用少量早期数据就能实现高精度预测,证明了在电池全生命周期的早期阶段进行准确RUL预测是完全可行的。同时,像1D-CNN这样的高效模型,其快速的预测能力为在车辆BMS等实时系统中部署先进的AI预测功能提供了现实可能性。

结论

核心结论: 本研究成功构建并验证了一个统一的机器学习框架,用于系统性地评估多种ANN架构在电池RUL预测任务中的表现。通过严谨的超参数优化和对比分析,研究确定了ResNet是精度最高的模型(MAPE为10.7%),而1D-CNN则是计算效率最高的优秀备选方案。一个关键的发现是,使用(40, 40)循环窗口的数据进行预测,其效果优于更长的数据序列,这表明针对性的早期数据对于准确预测电池寿命至关重要。

展望

可以改进的地方: 文献中未明确提及。但从文中可知,为了与先前研究进行公平对比,作者并未对数据集中的“异常值”(Outliers)进行清洗。如果未来能采用更鲁棒的方法处理这些异常数据,模型的整体性能和稳定性有望进一步提升。

下一步的方向: 文献中未明确提及。但本研究建立的评估框架本身就为未来的研究指明了方向,即可以利用此框架来测试更多新颖的神经网络架构,或将其应用于不同化学体系的电池数据集。此外,文中对模型计算复杂度的讨论也暗示了未来的一个重要研究方向:如何进一步优化这些高性能模型,使其能更轻量、更高效地部署在资源受限的嵌入式硬件上。

文献信息 原文标题: A machine learning framework for remaining useful lifetime prediction of li-ion batteries using diverse neural networks 发表日期: 2023年11月 期刊/来源: Energy and AI DOI链接: https://doi.org/10.1016/j.egyai.2023.100319

本文所分享的原文内容来源于网络。原文著作权归原作者所有,仅为分享优质内容目的转发,学习与讨论,未用于商业盈利,若有侵权请联系删除。

(1).jpg)